HOME | ÍNDICE POR TÍTULO | NORMAS PUBLICACIÓN

HOME | ÍNDICE POR TÍTULO | NORMAS PUBLICACIÓN Espacios. Vol. 37 (Nº 09) Año 2016. Pág. 20

Cassius Sanches Gachido de SOUZA 1, Jonas Sala 2, Alan Rodrigo TOGNI 3, Waltraudi Orchulhak KAWAMOTO 4, Cecília Sosa Peixoto Arias 5, Luiz Teruo KAWAMOTO JÚNIOR 6

Recibido: 30/11/15 • Aprobado: 18/01/2016

RESUMO: Diante entrevista realizada com um portador de deficiência visual grave, foi constada a dificuldade e riscos para a locomoção desse tipo de deficiente nos mais variados ambientes, principalmente ruas e locais desconhecidos. O objetivo dessa pesquisa é desenvolver um dispositivo para proporcionar ao deficiente visual, antecipação na detecção de obstáculos, aumentando seu tempo de reação. Trata-se de uma aplicação eletrônica com a utilização de Arduino, transdutor ultrassônico para captar a distância de obstáculos e micromotor vibratório para alertar a distância existente quem utiliza o dispositivo e o obstáculo, prevenindo colisões. Para isso acoplou-se o dispositivo a um boné, o qual foi escolhido devido ao seu formato anatômico e fácil regulagem na cabeça, possibilitando ao deficiente visual varrer a área a sua frente com a movimentação do pescoço. |

ABSTRACT: Interviews with a severe visual impairment person, it was revealed the difficulty and the risks for locomotion of such handicap in various environments, especially unknown streets and locations. The objective of this research is to develop a device to provide the visually impaired, advances in detecting obstacles by increasing your reaction time. It is an electronic application with the use of Arduino, ultrasonic transducer to capture the distance of obstacles and vibration micromotor to alert the distance of the objects who uses the device and the obstacle, preventing collisions. For this coupled up the device to a cap, which was chosen because of its anatomical and easy adjustment on the head shape, enabling the visually impaired sweep the area in front of her with the movement of the neck. |

A Organização Mundial da Saúde (HEALTH, 2013) calcula que existam 285 milhões de pessoas no mundo que convivem com problemas de visão, e destes, 39 milhões são totalmente cegas. Pesquisadores ao redor do mundo desenvolvem métodos e processos para a criação de produtos eletrônicos e softwares com o objetivo de prover autonomia para realizarem tarefas nesses produtos.

Segundo resultados obtidos no Censo Demográfico de 2010 realizado pelo Instituto Brasileiro de Geografia e Estatística (IBGE, 2010) no Brasil existem 45,6 milhões de pessoas com algum tipo de deficiência visual. Isso corresponde a 23,91% da população brasileira e destes, 6,7% (12,7 milhões) de indivíduos possuem pelo menos uma deficiência visual grave.

Em entrevista realizada com uma deficiente visual, foi citado que as maiores dificuldades enfrentadas por eles é a locomoção em ruas e espaços desconhecidos, pois o após um determinado período o deficiente se familiariza com o local e se habitua com os obstáculos, já em locais desconhecidos ele nunca saberá onde está o obstáculo.

No âmbito de mobilidade para pessoas com deficiência visual grave existem tecnologias assistivas para auxilio nestas dificuldades, mas que de acordo com a entrevista, possuem alguns problemas. São eles: 1 – A bengala, a mais popular e acessível tecnologia assistiva para cegos, porém ela tem um alcance de detecção de obstáculos curto e não avisa sobre obstáculos acima da linha da cintura; 2 – Cão-guia, a melhor solução por se tratar de um ser inteligente auxiliando o deficiente, porém inacessível para maioria da população brasileira por falta de centros de treinamento nacionais e dificuldades de se obter esse tipo de animal, pois ele vem de fora do país.

As tecnologias da informação e da comunicação têm como desafios a inclusão e a cidadania digital, podendo contribuir de forma substanciosa para a democracia do conhecimento (GOBBI, 2015)

A tecnologias emergentes estão transformando a sociedade. Se bem utilizadas, podem transformar nosso mundo num lugar melhor (CARVAJAL et.al., 2015).

O objetivo desta pesquisa é desenvolver um dispositivo eletrônico de tecnologia assistiva baseado em transdutores ultrassônicos para auxílio na detecção de obstáculos a uma distância de até 4 metros e com um campo de ação baseado no movimento de sua cabeça.

A seguir serão apresentadas pesquisas sobre o tema de ajuda para cegos em relação à localização de objetos e de guia por imagens.

Akhter et. al. (2011), utiliza um sistema vibro tátil para comunicação e é baseado em um sistema composto por micro controlador. Utiliza também câmera de um smartphone para gerar uma imagem estereoscópica.

Bernabei et al. (2011) apresentaram um sistema de baixo custo com a utilização de dispositivo Kinect, sistema composto de câmeras estéreo, desenvolvido para ser integrante de um console de jogos e o complemento do sensoriamento se dá pelo uso de acelerômetro e interação por auditory display.

Capi e Toda (2011), propõe um sistema composto de um robô equipado com câmera, laser, alto falantes para fornecer informações ao usuário sobre o ambiente ao seu redor. Utiliza arquitetura cliente servidor e É capaz de detector objetos a uma distância média de 70 centímetros e ângulos de até 90 graus.

Pesquisa de Cruz; Ramos e Ramírez (2011) utiliza o sensoriamento por BlueTooth e o processamento de imagens é baseado em imagens 3D. Utiliza arquitetura cliente servidor.

O projeto SmartVision (JOSÉ et al., 2011), utiliza um laptop e câmera, que funciona em ambientes indoor e outdoor. Utiliza algoritmos da visão computacional para detectar caminhos e imagens.

Ko; Ju e Kim (2011), desenvolveram um sistema que utiliza a câmera do smartphone e através de pictogramas coloridos ao longo do caminho, são identificadas e assim informam o usuário sobre sua posição atual.

Kurata et. al. (2011), pesquisaram um sistema indoor e outdoor, onde o posicionamento do usuário é obtido pelo uso de GPS, Wifi, Câmera e RFID.

O sistema RGB-D é um sistema de navegação baseado no sistema Kinect (LEE, 2011), sua interface de comunicação ocorre com o uso do BlueTooth. Permite realizar cálculos de rotas. O algoritmo principal é realizado pela visão computacional, porém o sistema completo se torna desconfortável por ser um conjunto para vestir.

Mann et al. (2011), desenvolveram um protótipo que utiliza o sistema Kinect e os algoritmos de visão computacional. O sistema é montado sobre um capacete, que consegue medir distancias de 0,3 metros a 6 metros. O sistema não efetua cálculos de rotas. A interação ocorre por atuadores com vibradores.

Equipamento de (SHAMSI; AL-QUTAYRI; JEEDELLA, 2011), apresenta a arquitetura de um sistema de auxílio para navegação de cegos para ambiente indoor. O sensoriamento é efetuado por uma rede de sensores ZigBee. Necessita de arquitetura Cliente-Servidor e utiliza Auditory Display para interagir com o usuário.

Um sistema composto de vestimentas com câmeras estéreo, fones de ouvidos e um computador portátil nas costas é proposto em (WENQIN; WEI; JIAN, 2011).

Uma proposta de uma simulação próxima da visão humana é apresentada em (ASAD; IKRAM, 2012). É baseada na visão computacional e utiliza a câmera de um smartphone Android, com algoritmo Vanishing Point.

O Cognitive Aid System for Blind People (CASBIiP) (DUNAI; GARCIA, 2012) é um sistema vestível que utiliza câmera estereoscópica capaz de identificar objetos a 15 metros de distância em ângulos de até 64 graus. A interação ocorre por um sistema acústico que avisa sobre os objetos e distância.

O Kinect é utilizado em (FILIPE et al., 2012); (KHAN et al., 2012); e (LANDA-HERNÁNDEZ; BAYRO-CORROCHANO, 2012), os algoritmos utilizados são as redes neurais para extração das informações do ambiente permitindo portanto a correta classificação do tipo de padrão encontrado. O hardware é equipado com duas câmeras, o que permite a análise estereoscópica da imagem e consequentemente permite extrair profundidade de uma imagem. Atua a uma distância de 3,6 metros.

Ivanov (2012) propõe o uso de expressões algébricas para cálculo de rotas e desvios de obstáculos. O sensoriamento é realizado pelo uso do RFID, acelerômetro, magnetrômetro, BlueTooth embarcados em um smartphone Android e necessita de comunicação com um servidor externo. Utilizam o auditory display como forma de interação.

Khan e Maccane (2012), utilizaram um smartphone Android em arquitetura cliente servidor. O aparelho captura as imagens do local e o servidor faz o reconhecimento da imagem e retorna o posicionamento do usuário.

O MOBIFREE é apresentado em (LOPES et al., 2012): um conjunto formado por uma bengala eletrônica que, composto de um conjunto de sensores ultrassónicos, detectam buracos e saliências no trajeto, um para de óculos com câmera para detectar obstáculos na altura dos olhos e sensores para captar o áudio do ambiente.

O ENV3 proposto por (MANDUCHI, 2012), utiliza a câmera de um smartphone para detecção de cores.

Molina; Zhu e Tian (2012) desenvolveram um aplicativo que utiliza uma câmera que reconhece imagens no ambiente e as compara com seu banco de imagens e assim proporciona ao usuário a obter a sua localização no ambiente.

Moreno et. al. (2012) desenvolveram um navegador em tempo real para cegos que utiliza a fusão de sensores de um smartphone Android, e realiza cálculo de rota e detecção de objetos de no mínimo 10 cm de diâmetro a uma distância de 2 a 5 metros. A interação é por auditory display.

Um notificador sonoro é apresentado em (MUHAMMAD; THOO; MASRA, 2012), o sistema foi simulado no Matlab e o sensoriamento é com o uso de uma câmera que captura sinal de raio laser emitido pelo atuador e baseado nas medições é capaz de detectar obstáculos distantes acima de 432 centímetros e avisos sonoros são emitidos ao usuário.

Um sistema de detecção de obstáculos (RODRÍGUEZ; YEBES; ALCANTARILLA, 2012) e o uso do algoritmo RANSAC e interação com bips de áudio e sensoriamento por câmeras foi desenvolvido.

O projeto CYCLOPS (SALONIKIDOU; SAVVAS, 2012), é um sistema open source vestível, utiliza o sensoriamento por ultrassom. Trata-se de uma luva eletrônica composta por sensores ultrassónico, vibrador para interação, bússola e outros sensores e atuadores.

Savakis et. al. (2012) desenvolveram um assistente para detectar faces em smartphone Android. Utiliza o método Lucas-Kanade para rastrear as faces e Viola Jones para reconhecimento dos padrões.

Schauerte et. al. (2012) desenvolveram um sistema baseado em visão computacional para auxiliar cegos a localizarem objetos perdidos em um ambiente. Utiliza o algoritmo SIFT.

Wang e Tian (2012) desenvolveram um sistema que propõe o uso da visão computacional para reconhecimento de padrões pelo algoritmo SIFT.

Foi desenvolvido um sistema composto de um boné e um dispositivo portátil para proporcionar a navegação segura e independente, que avisa sobre obstáculos. Utiliza um conjunto de micro controladores e o sensoriamento é realizado por meio de sensores de micro-ondas. Capaz de informar a direção e a distância dos objetos ao redor (AL-FAHOUM; AL-HMOUD; AL-FRAIHAT, 2013).

O sensoriamento com barômetro é apresentado em (YICHENG BAI, WENYAN JIA, HONG ZHANG, ZHI-HONG MAO, 2013), que utilizaram um sistema embarcado com a placa Arduino Uno. Um sensor e com conexão USB a um computador, permitiu identificar a altitude de um objeto e assim informar o andar em que se encontrava.

Bellotto (2013) pesquisou um sistema multimodal composto de um smartphone Android, e através da biblioteca Open Audio Library, a interface 3D audio spacialization oferece um solução econômica e alternativa quando comparados com sistemas ubíquos. O sistema trabalha em conjunto com outros sistemas de localização por imagens.

Barberis; Botino; e Malnati (2013 desenvolveram um sistema de baseado em visão computacional para permitir a navegação e a localização indoor. Utiliza smartphone Android e o sensoriamento é pelas câmeras que lê marcações no ambiente.

Dunai et. al. (2013) pesquisaram um sistema composto por câmera 3D CMOS embutidos em um par de óculos, fones de ouvidos e circuito FPGA para detecção de objetos. O sistema é similar ao utilizado pelos morcegos para identificar e calcular a distância de um objeto.

Tian et. al. (2013) pesquisaram o uso da computer vision para auxiliar cegos em ambientes não familiares. Incorporaram um reconhecedor de objetos e de textos. O sistema consiste em detectar portas, elevadores e cabines. É baseado na forma geométrica dos objetos a serem reconhecidos.

Primeiramente foi efetuada revisão bibliográfica do assunto.

A proposta do dispositivo é utilizar o transdutor ultrassônico para detectar a distância entre o usuário e obstáculos à sua frente. Dependendo da distância detectada um micromotor vibratório é acionado para avisar sobre a existência de obstáculos. O micromotor vibrará em três intervalos diferentes, quanto mais rápida a frequência de vibração mais próximo se encontra o obstáculo.

Para complementar o dispositivo, é proposto a utilização de um componente para ajustar a sensibilidade do transdutor ultrassônico e frequência da vibração do micromotor. Em condições normais, o transdutor detecta obstáculos a até 4 metros ocorrendo vibração do micromotor à 3 metros (baixa frequência), 2,5 metros (média frequência) e 1,5 metros (alta frequência). Estas distâncias são adequadas para ambientes externos, porém para ambientes fechados em que a distância entre os obstáculos tende a ser menor, a detecção e consequentemente a frequência das vibrações precisa ser menor. No primeiro protótipo foi utilizado um potenciômetro analógico simples.

A validação foi feita por uma voluntária cega que respondeu um questionário de opinião.

Por fim, foram escritas as discussões e a conclusão.

Por se tratar de um projeto de tecnologia assistiva, os principais componentes e conceitos devem ser definidos para melhor compreensão do funcionamento do dispositivo.

Conforme a descrição do fabricante, "Arduino é uma plataforma de prototipagem eletrônica open-source baseada em software e hardware flexível e de fácil utilização". Trata-se de um microcontrolador integrado a uma placa com portas de acesso definidas e um ambiente de desenvolvimento para escrever softwares para este microcontrolador. Neste projeto utilizou-se Arduino Uno.

Segundo especificações do fabricante (Quadro 1), o Arduino Uno utiliza o micro controlador ATmega328. Tem 14 pinos de entrada e saída digital, 6 pinos de entrada analógicos, um ressonador cerâmico de 16 MHz, um conector USB, uma entrada para cabo de força. Estes componentes dão suporte ao trabalho com o micro controlador tornando simples utilizar o Arduino para desenvolver protótipos.

Quadro 1 - Especificações técnicas do Arduino UNO.

Micro controlador |

ATmega328 |

Tensão de operação |

5V |

Voltagem de entrada (recomendada) |

7V a 12V |

Voltagem de entrada (limites) |

6V mínimo, 20V máximo |

Pinos de E/S digitais |

14 (dos quais 6 fornecem saída PWM) |

Pinos de entrada analógica |

6 |

Corrente por pino de E/S |

40mA |

Corrente por pino de 3,3V |

50mA |

Memória Flash |

32KB |

SRAM |

2KB |

EEPROM |

1KB |

Velocidade de Clock |

16MHz |

Fonte: Arduino (2015).

Segundo Thomazini e Albuquerque (2004), transdutores são dispositivos completos, contendo o sensor que transforma uma grandeza qualquer em outra que pode ser utilizada em dispositivos de controle.

Neste projeto são utilizados transdutores ultrassônicos que segundo Thomazini e Albuquerque (2004), seguem o seguinte funcionamento: cristais de piezelétricos ressonam a uma frequência desejada, muito mais altas que as audíveis pelo ouvido humano, convertendo energia elétrica em acústica e vice-versa. Essas ondas são transmitidas através do meio em formato de cone e caso encontrem um obstáculo são refletidas de volta para o transdutor.

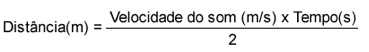

A velocidade do som em condições normais é de 340,29 metros por segundo e medindo o tempo ente a emissão e recepção das ondas ultrassônicas é possível definir a distância entre o transdutor e obstáculo, segundo a equação:

As ondas ultrassônicas percorrem a distância do transdutor até o obstáculo e do obstáculo de volta ao transdutor. Justamente por isso o resultado da equação clássica é divido por 2.

Este projeto utiliza um transdutor ultrassônico modelo HSR – 04.

Ainda segundo Thomazini e Albuquerque (2004), para o correto funcionamento dos transdutores ultrassônicos exige-se uma distância mínima entre o transdutor e o obstáculo afim de prover um atraso no tempo de forma que os "ecos" possam ser corretamente interpretados.

Algumas variáveis podem alterar o comportamento das ondas ultrassônicas e consequentemente o funcionamento do transdutor. Entre as variáveis incluem: ângulo de superfície do objeto, rugosidade da superfície, temperatura e humidade do ambiente. Os obstáculos podem ter qualquer tipo de forma refletiva até mesmo ser redondas (Quadro 2).

Quadro 2 - Especificações técnicas do transdutor ultrassônico HC – SR04.

Tensão de operação |

DC 5V |

Corrente de operação |

15mA |

Frequência de operação |

40Hz |

Frequência da onda ultrassônica |

40kHz |

Distância máxima de detecção |

4 metros |

Distância mínima de detecção |

2 centímetros |

Ângulo de medida |

15 graus |

Dimensões físicas |

45 x 20 x 15 milimetros. |

4.1.3 Micromotor vibratório

Trata-se de um micromotor de corrente contínua com eixo fora de centro. Quando acionado este motor emite uma vibração que pode ser percebida pelo usuário do dispositivo.

É um micromotor simples muito similar àqueles que são encontrados em telefones celulares.

Foi elaborado o modelo de circuito para planejar as ligações dos componentes com o Arduino.

Após finalizado o modelo do circuito foi desenvolvido o primeiro protótipo simples (Figura 5), para testar o funcionamento dos dispositivos e as capacidades de detecção do transdutor e vibrações do micromotor. Nesta etapa também foi desenvolvido o software para que o Arduino possa controlar os componentes ligados a ele.

Inicialmente o micromotor vibratório foi substituído por um Diodo Emissor de Luz (LED) para facilitar o desenvolvimento do circuito, pois o motor vibrava muito e se desconectava da placa de prototipagem com frequência. Mesmo com essa alteração software continuaria o mesmo.

Os testes realizados com o primeiro protótipo evidenciam que o esquema eletrônico e o software para controle funcionam como esperado, detectando obstáculos dentro das faixas determinas com o auxílio de um potenciômetro. O micromotor vibratório também se comportou de maneira satisfatória indicando que a proposta de dicas táteis de obstáculos através de vibrações seria eficaz.

Através dos testes do primeiro protótipo foi comprovado que o dispositivo funcionava como esperado então foi iniciado o desenvolvimento do dispositivo em seu pleno funcionamento.

O transdutor ultrassônico, o micromotor vibratório e o potenciômetro foram fixados em um boné. Estes são conectados ao Arduino, projetado para ser preso a cintura, através de um cabo de pares trançados categoria 6 (cabo de rede CAT-6) conectados através de RJ-45. A facilidade de uso e baixo custo desses cabos e conectores foram decisivos na escolha.

Um boné foi escolhido para implementação do dispositivo, pois é utilizado na parte superior do corpo do usuário e também permite detecção de obstáculos através da movimentação da cabeça. Em adição a isso, é um item confortável e facilmente ajustável a cada indivíduo. O software continuou igual ao do primeiro protótipo (Figuras 1).

Figura 1 – Imagem inferior do dispositivo

Utilizado em conjunto com a bengala o dispositivo pretende ser eficaz principalmente para detectar obstáculos que a bengala não alcança e, sobretudo obstáculos acima da linha da cintura.

No dia 1 de Novembro de 2013, na biblioteca da faculdade Anhanguera de Piracicaba foram realizados testes dos dispositivos por uma deficiente visual (Figura 9). Foi apresentado a ela o dispositivo e dadas as instruções de uso.

Foi solicitado à deficiente visual que caminhasse pela biblioteca utilizando o dispositivo e sua bengala e enquanto isso foram colocados obstáculos aleatórios em seu caminho.

Após o termino dos testes de uso, foi solicitado a deficiente visual que respondesse um questionário de avaliação para a voluntária a respeito do dispositivo. Para complementar os testes de uso, durante a utilização foram coletados dados do dispositivo com o auxílio de um notebook conectado ao Arduino.

Os resultados dos testes foram satisfatórios e a maior parte dos obstáculos foi detectada com boa antecipação ajudando a deficiente visual a ter mais atenção com áreas em que o dispositivo detectou algum obstáculo. Alguns resultados foram limitados pelas particularidades do uso de transdutores ultrassônicos, como ângulo dos objetos em relação ao dispositivo e perturbações do ar.

Pelos testes realizados junto a um usuário com reais necessidades de tecnologia assistiva para deficientes visuais, tendo em vista as opiniões expressas por ele em um questionário o dispositivo atende as expectativas iniciais deste projeto: detectar com antecedência obstáculos a frente do usuário sobretudo acima da linha da cintura.

A implementação do dispositivo em um boné se mostrou útil, pois o usuário podia varrer o ambiente com o movimento de sua cabeça, detectando mais obstáculos. Esse foi um ponto positivo e negativo ao mesmo tempo. Se por um lado ela conseguia maior campo de detecção de obstáculos por outro nem sempre tinha certeza de onde o obstáculo se encontrava.

Um ponto a ser explorado, baseado no desejo expresso pelas respostas da voluntária no questionário avaliativo do teste, é implementar o dispositivo em outros itens de vestuário para cabeça como chapeis, lenços e tiaras.

AKHTER, S. et al. A Smartphone-based Haptic Vision Substitution system for the blind. 2011 IEEE 37th Annual Northeast Bioengineering Conference (NEBEC), p. 1–2, abr. 2011.

AL-FAHOUM, A. S.; AL-HMOUD, H. B.; AL-FRAIHAT, A. A. A Smart Infrared Microcontroller-Based Blind Guidance System. Active and Passive Electronic Components, v. 2013, p. 1–7, 2013.

ASAD, M.; IKRAM, W. Smartphone based guidance system for visually impaired person. Image Processing Theory, Tools and Applications (IPTA), 2012 3rd International Conference on, p. 442–447, 2012.

ARDUINO. What is Arduino?, 2013. Disponível em <http://arduino.cc/en/Guide/ Introduction>. Acesso em 18 nov. 2013.

BARBERIS, C., BOTTINO, A., MALNATI, G. P. M. Experiencing indoor navigation on mobile devicesIndoor navigation on mobile devices: problems, solutions and open issues. Anais...2013

BELLOTTO, N. A Multimodal Smartphone Interface for Active Perception by Visually Impaired. IEEE SMC Int. Workshop on Human-Machine Systems, Cyborgs and Enhancing Devices (HUMASCEND), 2013.

BERNABEI, D. et al. A Low-Cost Time-Critical Obstacle Avoidance System for the Visually Impaired. International Conference On Indoor Positioning And Indoor Navigation, n. September, p. 21–23, 2011.

BERSH, Rita. Introdução à tecnologia Assistiva Universidade CEDI – Centro Especializado em Desenvolvimento Infantil. Porto Alegre - RS, 2008, p. 2, 9 e 10.

CAPI, G.; TODA, H. A new robotic system to assist visually impaired people. 2011 Ro-Man, p. 259–263, jul. 2011.

CARVAJAL JR. C. J. et. al. (orgs). Empreendedorismo, tecnologia e inovação. São Paulo: Livrus, 2015.

CRUZ, O.; RAMOS, E.; RAMÍREZ, M. 3D Indoor Location and Navigation System Based on BluetoothElectrical Communications and Computers (CONIELECOMP), 2011 21st International Conference on. Anais...2011.

DUNAI, L. et al. Sensory Navigation Device for Blind People. Journal of Navigation, v. 66, n. 03, p. 349–362, 25 jan. 2013.

DUNAI, L.; GARCIA, B. 3D CMOS sensor based acoustic object detection and navigation system for blind people3D CMOS sensor based acoustic object detection and navigation system for blind people. Anais...2012Disponível em: <http://ieeexplore.ieee.org/xpls/abs_all.jsp?arnumber=6389214>.

FILIPE, V. et al. Blind Navigation Support System based on Microsoft Kinect. Procedia Computer Science, v. 14, n. Dsai, p. 94–101, jan. 2012.

GOBBI, M. C. Tecnologias educacionais: inclusão e cidadania. Mídias Culturais e Políticas Culturais, v. 1, 2015.

HEALTH, W. O. Visual impairment and blindness. Disponível em: <http://www.who.int/mediacentre/factsheets/fs282/en/>. Acesso em: 20 jan. 2014.

IBGE. Censo Demográfico 2010. Brasília, 2010. Disponível em:http://www.ibge.gov.br>; acesso em: 12 nov. 2013.

IVANOV, R. RSNAVI : An RFID-Based Context-Aware Indoor Navigation System for the Blind. Proceedings of the 13th International Conference on Computer Systems and Technologies. ACM, p. 313–320, 2012.

JOSÉ, J. et al. The SmartVision local navigation aid for blind and visually impaired persons. International Journal of Digital Content Technology and its Applications, v. 5, n. 5, p. 362–375, 2011.

KHAN, A. et al. KinDectect : Kinect Detecting Objects. Computers Helping People with Special Needs. Springer Berlin Heidelberg, p. 588–595, 2012.

KHAN, N.; MCCANE, B. Smart Phone Application for Indoor Scene LocalizationProceedings of the 14th international ACM SIGACCESS conference on Computers and accessibility. Anais...2012

KO, E.; JU, J. S.; KIM, E. Y. Situation-based indoor wayfinding system for the visually impaired. The proceedings of the 13th international ACM SIGACCESS conference on Computers and accessibility - ASSETS '11, p. 35, 2011.

KURATA, T. et al. Indoor-Outdoor Navigation System for Visually-Impaired Pedestrians: Preliminary Evaluation of Position Measurement and Obstacle Display. 2011 15th Annual International Symposium on Wearable Computers, n. 1, p. 123–124, jun. 2011.

LANDA-HERNÁNDEZ, A.; BAYRO-CORROCHANO, E. Cognitive guidance system for the blindWorld Automation Congress (WAC), 2012. Anais...2012Disponível em: <http://ieeexplore.ieee.org/xpls/abs_all.jsp?arnumber=6321039>.

LEE, Y. H. RGB-D camera Based Navigation for the Visually Impaired. RSS 2011 RGBD: Advanced Reasoning with Depth Camera Workshop, p. 1–6, 2011. LEGGE, G. E. et al. Indoor navigation by people with visual impairment using a digital sign system. PloS one, v. 8, n. 10, p. e76783, jan. 2013.

LOOMIS, J.; GOLLEDGE, R.; KLATZKY, R. Navigation system for the blind: Auditory display modes and guidance. Presence: Teleoperators and …, p. 193– 203, 1998.

LOPES, S. I. et al. MobiFree: A Set of Electronic Mobility Aids for the Blind. Procedia Computer Science, v. 14, n. Dsai, p. 10–19, jan. 2012.

MANDUCHI, R. Mobile vision as assistive technology for the blind: Na experimental study. Computers Helping People with Special Needs, n. 1, 2012.

MANN, S. et al. Blind navigation with a wearable range camera and vibrotactile helmet. Proceedings of the 19th ACM international conference on Multimedia - MM '11, p. 1325, 2011.

MORENO, M. et al. Realtime Local Navigation for the Blind: Detection of Lateral Doors and Sound Interface. Procedia Computer Science, v. 14, n. Dsai, p. 74–82, jan. 2012.

MUHAMMAD, M. S.; THOO, Y. W.; MASRA, S. M. W. Sound navigation aid system for the vision impaired. 2012 IEEE Colloquium on Humanities, Science and Engineering (CHUSER), n. Chuser, p. 288–293, dez. 2012.

RAJ, C. P. R.; TOLETY, S.; IMMACULATE, C. QR code based navigation system for closed building using smart phones. 2013 International Mutli-Conference on Automation, Computing, Communication, Control and Compressed Sensing (iMac4s), p. 641–644, mar. 2013.

RODRÍGUEZ, A.; YEBES, J.; ALCANTARILLA, P. Assisting the Visually Impaired: Obstacle Detection and Warning System by Acoustic Feedback. Sensors, v. 12, n. 12, p. 17476–17496, 2012.

SALONIKIDOU, B.; SAVVAS, D. Development and evaluation of an open source wearable navigation aid for visually impaired users (CYCLOPS). Bioinformatics & Bioengineering (BIBE), 2012 IEEE 12th International Conference on, November, p. 115–120, 2012.

SAVAKIS, A. et al. Low vision assistance using face detection and tracking on android smartphones. 2012 IEEE 55th International Midwest Symposium on Circuits and Systems (MWSCAS), p. 1176–1179, ago. 2012.

SCHAUERTE, B. et al. An Assistive Vision System for the Blind That Helps Find Lost Things. Computers Helping People with Special Needs. Springer Berlin Heidelberg, p. 566–572, 2012.

SHAMSI, M. AL; AL-QUTAYRI, M.; JEEDELLA, J. Blind assistant navigation system. 2011 1st Middle East Conference on Biomedical Engineering. Anais...Ieee, fev. 2011Disponível em: <http://ieeexplore.ieee.org/lpdocs/epic03/wrapper.htm?arnumber=5752090>

TAKIZAWA, H. et al. Kinect cane: Object recognition aids for the visually impaired. 2013 6th International Conference on Human System Interactions (HSI), p. 473–478, jun. 2013.

TIAN, Y. et al. Toward a Computer Vision-based Wayfinding Aid for Blind Persons to Access Unfamiliar Indoor Environments. Machine vision and applications, v. 24, n. 3, p. 521–535, 1 abr. 2013.

THOMAZINI, Daniel. ALBUQUERQUE, Pedro U. B. Sensores Industriais – Fundamentos e Aplicações. 4ª ed. São Paulo: Érica, 2004, p. 17, 18, 37 e 38.

ULTRASONIC RANGING MODULE HC–SR04, 2013. Disponível em http://www.electroschematics.com/ wp-content/ uploads/2013/07/HCSR04-datasheet-version-1.pdf>. Acesso em 18 nov. 2013.

WANG, S.; TIAN, Y. Camera-based Signage Detection and Recognition for Blind Persons Methodology for Restroom Signage Detection and Recognition. Computers Helping People with Special Needs. Springer Berlin Heidelberg, p. 17–24, 2012.

WENQIN, S.; WEI, J.; JIAN, C. A machine vision based navigation system for the blind. Computer Science and Automation Engineering (CSAE), 2011 IEEE International Conference on, v. 3, p. 81–85, 2011.

YICHENG BAI, WENYAN JIA, HONG ZHANG, ZHI-HONG MAO, AND M. S. Helping the blind to find the floor of destination in multistory buildings using a barometer. Engineering in Medicine …, 2013.1. Graduado em Ciência da Computação

2. Graduado em Ciência da Computação

3. Graduado em Ciência da Computação

4. Graduada em Odontologia, Especialista em Informática na Saúde, Mestra e Doutora em Engenharia Biomédica. Professora universitária.

5. Possui graduação em Computador Universitário - Universidad Nacional de Salta (1987), graduação em Licenciatura em Análise de Sistemas - Universidad Nacional de Salta (1989), mestrado em Ciência da Computação pela Universidade Estadual de Campinas (1992) e doutorado em Engenharia Elétrica pela Universidade Estadual de Campinas (1997). Pós doutorado em Engenharia Elétrica pela Universidade Estadual de Campinas (1999). Tem experiência na área de Ciência da Computação, com ênfase em Engenharia de Software, atuando principalmente nos seguintes temas: especificação de interfaces homem-computador, especificação de requisitos, sistemas especialistas, ambientes para ensino a distância, tecnologias assistivas. Atualmente trabalha na área de Treinamentos e de Gestão do Conhecimento. Pesquisador colaborador na UNICAMP-FEEC-DECOM-COMLAB com co-orientações de Mestrado e Doutorado. Professora e Orientadora dos cursos de Pós-Graduação do Centro Unisal.

6. Pesquisador nas áreas de engenharia e administração. Professor com experiência em docência nos níveis técnico, de graduação, especialização, mestrado e doutorado. Na área empresarial, experiência em projetos na área de gestão de informática. Doutor em Engenharia Biomédica; Mestre em Tecnologia Ambiental; MBA em Tecnologia da Informação Aplicada à Gestão de Negócios; Especialista em Informática na Saúde; Tecnólogo em Informática; e Bacharel em Administração de Empresas. Email: luizteruo@hotmail.com